当您将先进技术与战争和政府监视相交叉时,您会得到什么?数百名未解决的员工,数十万陷入困境的员工以及无法估量的不良公关。

在亚马逊,员工对公司决定将其Rekognition面部识别软件出售给警察部门和政府机构的决定感到震惊。这项技术使用人工智能 (AI) 来实时识别、跟踪和分析人脸,亚马逊声称它可以在一张图像中识别多达100个人,并识别 “感兴趣的人”,用于政府监控等目的。今年5月,美国公民自由联盟 (ACLU) 的一项调查显示,亚马逊正在积极营销面部识别软件,并将其出售给政府机构。

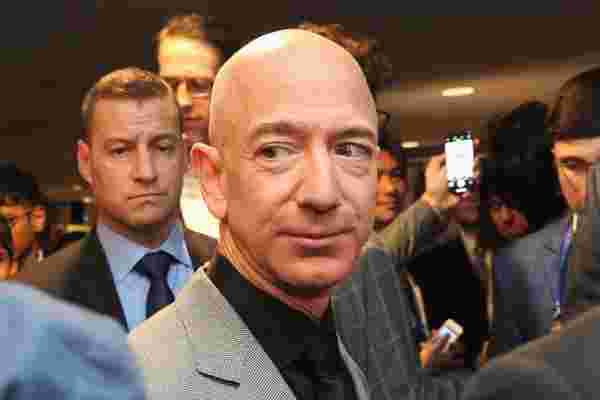

亚马逊员工没有。在上周致首席执行官杰夫·贝佐斯 (Jeff Bezos) 的一封内部信中,员工提到了ACLU报告,以及他们担心该软件将被用来伤害最边缘化的人。

信中写道: “像我们这样的技术在社会的许多部门都发挥着越来越重要的作用。”“我们清楚的是,我们的开发和销售实践尚未承认随之而来的义务。只关注股东价值是一场触底的竞赛,也是我们不会参与的竞赛。我们拒绝建立为ICE提供动力的平台,我们拒绝为侵犯人权的工具做出贡献。就道德而言,亚马逊人,我们要求选择建造的东西,并要求在使用方式上发表意见。我们从历史中学习,我们了解IBM的系统是如何在20世纪40年代中使用来帮助希特勒的。当时IBM没有承担责任,当他们的角色被理解时,已经太晚了。我们不会让这种情况再次发生。”

员工呼吁亚马逊停止向执法机构出售面部识别服务,停止与palantir和其他与美国移民和海关执法局 (ICE) 合作的公司合作,完全退出监视业务,并对哪些公司和机构实施强有力的透明度措施正在使用亚马逊服务以及如何使用。在大声疾呼时,亚马逊员工将自己的声音添加到许多其他人的声音中。周一,民权,宗教和社区组织访问了亚马逊在西雅图的总部,提供了150,000多个请愿书签名,由美国70个社区组织签署的联盟信以及公司股东的来信。

亚马逊网络服务 (AWS) 在6月的博客文章中说,该公司的面部识别软件还用于防止人口贩运,儿童剥削和包裹盗窃。

AWS人工智能总经理Matt Wood博士写道: “我们认为,禁止有前途的新技术是错误的做法,因为将来它们可能被不良行为者用于邪恶的目的。”“如果我们限制人们购买电脑,世界将是一个非常不同的地方,因为有可能使用电脑造成伤害。”

该公司没有回应进一步评论的请求,也没有公开回应员工的公开信。

亚马逊正在发生的事情表明,近几个月来,科技行业的趋势要大得多。员工们正在意识到 -- 并采取行动 -- 他们团结起来塑造公司政策的能力,以及他们关心的事业的轨迹。

都柏林城市大学计算机教授艾伦·斯梅顿 (Alan Smeaton) 表示: “由于这场特别的辩论是由公司内部的员工领导的,它正在一个非常公开的论坛上进行,这是不寻常的。”“这确实表明了一场来自内部的权力斗争。”

在1月的博客文章中,微软吹捧其以云服务支持ICE的国土安全工作而感到自豪。最近几周,特朗普政府对非法越境人员的有争议的 “零容忍” 政策因将2,300多名儿童与家人分开而成为头条新闻。(在全国范围内引起轩然大波之后,特朗普总统此后在该政策上退缩,签署了一项行政命令,以使家庭团聚。)上周,超过100名微软员工签署了一封致首席执行官萨蒂亚·纳德拉 (Satya Nadella) 的公开信,抗议该公司与ICE签订的1940万美元合同。

信中写道: “我们认为微软必须采取道德立场,将儿童和家庭置于利润之上。”“作为制造微软从中获利的技术的人,我们拒绝成为同谋。我们是一个不断发展的运动的一部分,由整个行业的许多人组成,他们认识到那些创造强大技术的人必须承担的重大责任,以确保他们所建造的东西被用来是好的,而不是用来伤害。“

在给员工的内部备忘录中,纳德拉 (Nadella) 谴责边境的家庭分居政策 “残酷和虐待”,但他也淡化了该公司与ICE的关系。“我想说清楚: 微软没有与美国政府合作开展任何与边境儿童与家人分离有关的项目,“他写道,并提到提供的云服务是针对“ 遗留邮件、日历、消息传递和文档管理工作负载 ”。他没有为这些合同制定具体的透明度准则,在回应置评请求时,一位代表告诉企业家,微软没有什么可分享的了。

亚马逊和微软的员工并不是唯一发出警报的技术人员。

3月,科技新闻网站Gizmodo首次报道了Google决定使用AI来支持一个有争议的军事试点计划,该计划名为project Maven。该计划旨在通过对人和物体的图像进行自动分类来改善无人机镜头分析,并可用于使无人机打击更加准确。Google的参与引发了大约12名员工辞职。

“在某个时候,我意识到我不能真诚地推荐任何人加入谷歌,知道我所知道的,” 一位辞职的谷歌员工在5月份告诉Gizmodo。“我意识到,如果我不能推荐人们加入这里,那我为什么还在这里?”(在相关新闻中,该公司在4月底或5月初从公司范围内的行为准则中悄悄删除了其长期以来的 “不要作恶” 座右铭。)

谷歌参与Maven项目引起了公众的广泛抗议,全国各地的人工智能研究人员签署了一封公开信,呼吁该公司承诺永远不要将其技术武器化。谷歌6月宣布,明年到期后,它将不再与五角大楼续签合同,并完全退出与军方出于人工智能目的的合作。

“我们认识到,如此强大的技术对它的使用提出了同样强大的问题,” 谷歌在6月的一篇博客文章中发表,宣布该公司不会续签五角大楼合同。该公司为其未来在人工智能领域的工作制定了七项原则,澄清了这些原则不会被视为理论概念,而是被视为 “将积极指导我们研究和产品开发的具体标准”。原则本身: 对社会有益,避免造成或加强不公平的偏见,进行安全建设和测试,对人们负责,纳入隐私设计原则,坚持科学卓越的高标准,并可用于符合这些原则的用途。

谷歌还清楚地为人工智能使用制定了明确的指导方针,尽管可以说该语言可以留出一些回旋余地。至于造成或可能造成整体危害的技术,公司澄清: “在存在重大伤害风险的情况下,我们只会在我们认为收益大大超过风险的情况下继续进行,并将纳入适当的安全约束。”该公司表示,它不会在武器或 “其他主要目的或实施是造成或直接促进人员伤害的技术上进行合作,以及“ 收集或使用信息进行监视的技术违反了国际公认的规范 ”和“ 其目的违反了广泛接受的国际法和人权原则的技术 ”。谷歌拒绝对企业家发表进一步评论。

当谈到技术工人的集体权力来塑造公司政策的性质时,其影响遍及行业、政治和国际关系。

根据最近一份名为 “恶意使用人工智能” 的报告背后的26位作者的说法,研究人员,政策制定者和科技公司尚未正确探索这些含义。作者的背景涵盖学术界,民间社会和工业界,从剑桥大学到人类未来研究所。在政治安全方面,该报告强调了AI可能用于有针对性的宣传和欺骗,例如操纵视频或人类演讲。

该报告强调了对教育、道德标准和期望的需求,该报告称: “人工智能研究人员和雇用他们的组织在塑造人工智能世界的安全格局方面处于独特的地位。”

最近的涌入并不是人工智能第一次卷入争议。2015年,Google photos将非裔美国人用户标记为大猩猩,2017年,FaceApp的俄罗斯开发人员通过减轻肤色来 “美化” 面孔。但斯梅顿说: “我们现在看到的是不同的。”这是因为先前的争议与使用用于训练技术的倾斜数据有关,而不是人工智能技术本身。

人工智能研究人员越来越意识到,他们打算用于一种用途的工作是如何被其他人用于完全不同的东西 -- 甚至可能是出于恶意。Smeaton以剑桥大学研究员Aleksandr Kogan为例。“Kogan并不是第一个发现一旦他的作品开箱即用,其他人就会控制它的使用方式,” 他说,并提到在看到广岛和长崎原子弹造成的破坏后,罗伯特·奥本海默 (Robert Oppenheimer) 试图停止进一步的开发,然后辞去了曼哈顿计划。“在某种程度上,我们看到历史在重演,” 斯梅顿说。

美国民权活动家玛雅·威利 (Maya Wiley) 表示: “科技需要它的人才,它的人才比我…们大多数人更清楚技术将释放出的地震变化。”“这并不全是好事,我们必须先做人,然后再赚钱。”

在谷歌参与战争技术和五角大楼的消息传出后,超过300名科技行业员工签署了一份致谷歌、亚马逊、微软和IBM的请愿书,其前提是: 科技不应该从事战争。

它说: “我们中许多签署这份请愿书的人每天都面临着技术设计和开发方面的道德决策。”“我们不能忽视我们工作的道德责任,我…们代表着一个不断增长的科技工作者网络,他们承诺永远不会 '只服从命令',而是要让自己、彼此和行业承担责任。”

版权及免责声明:凡本网所属版权作品,转载时须获得授权并注明来源“融道网”,违者本网将保留追究其相关法律责任的权力。凡转载文章,不代表本网观点和立场。

延伸阅读

版权所有:融道网